Spørsmålet i dag er ikke lenger hva AI kan gjøre, men hva vi tør å la den gjøre. For en produktdesigner er ikke lenger den største utfordringen å lage en effektiv algoritme, men å designe et grensesnitt der brukeren faktisk våger å stole på resultatet.

Vi har lagt bak oss perioden der vi lot oss blende av magiske svar fra «svarte bokser». Brukerne har blitt mer krevende, og med rette. De har opplevd hallusinasjoner, skjevheter (bias) og ugjennomsiktige avgjørelser. I dagens marked er tillit den eneste valutaen som virkelig betyr noe.

Her er hvordan vi som designere må jobbe for å bygge etisk og transparent AI.

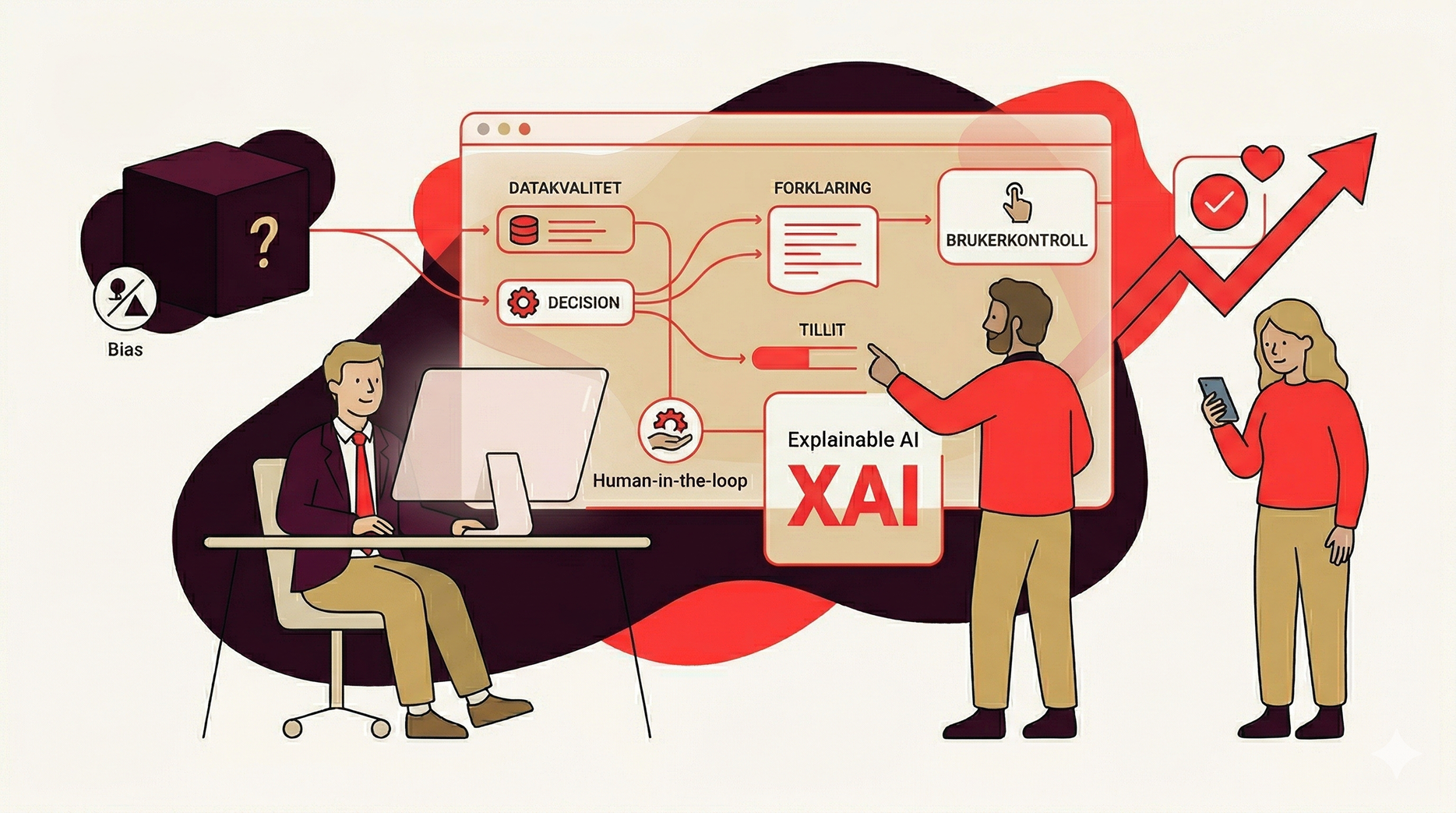

Fra «Black Box» til «Explainable AI» (XAI)

Den største barrieren for tillit er mangel på innsyn. Hvis en AI nekter deg et lån eller foreslår en medisinsk diagnose, er ikke svaret i seg selv nok – brukeren trenger å vite hvorfor.

Som produktdesignere er oppgaven vår å oversette komplekse maskinlæringsprosesser til forståelig menneskespråk. Dette kaller vi Explainable AI. Det handler ikke om å vise frem råkode, men om å designe «forklaringsmodeller»:

- Kontekstuelle hint: Små infobokser som forklarer hvilke data som ligger til grunn for et spesifikt svar.

- Sannsynlighetsvisning: I stedet for å presentere et svar som en absolutt sannhet, viser vi at «systemet er 85 % sikkert på dette». Dette gir brukeren rom for egen kritisk vurdering.

Design for menneskelig kontroll (Human-in-the-loop)

Etisk design handler om maktbalanse. En bruker skal aldri føle seg fanget av en algoritme. En god digital produktdesigner sørger for at AI-en fungerer som en assistent, ikke en diktator.

Dette betyr at vi må designe tydelige avkjøringsveier:

- Enkel korrigering: Hvis AI-en tar feil, må brukeren kunne overstyre valget med et tastetrykk. Systemet må lære av denne korrigeringen i sanntid.

- Tydelig eierskap: Brukeren må alltid sitte med den endelige avgjørelsen i kritiske prosesser. Vi designer for empowerment, ikke automatisering av menneskelig dømmekraft.

Arkitektur for etikk og skjevheter

Skjevheter i data (bias) er AI-ens største synd. Hvis treningsdataene er preget av historiske urettferdigheter, vil AI-en bare effektivisere disse feilene.

Her kommer Product Discovery inn som et etisk verktøy. Vi må tørre å stille de ubehagelige spørsmålene tidlig i prosessen:

- Representerer disse dataene alle brukerne våre, eller bare et privilegert utvalg?

- Hvem blir rammet hvis denne algoritmen tar feil?

- Har vi designet for universell utforming slik at AI-en er tilgjengelig for alle, uavhengig av funksjonsevne?

Gjennomsiktighet som konkurransefortrinn

Mange bedrifter frykter at for mye gjennomsiktighet vil avsløre forretningshemmeligheter eller gjøre brukeropplevelsen rotete. Erfaringen viser det motsatte: Merkevarer som tør å være åpne om hvordan de bruker AI, hvordan data blir behandlet, og hvilke begrensninger teknologien har, vinner lojalitet.

Å designe for tillit betyr å være ærlig når systemet er usikkert. Det er bedre med en AI som sier «jeg vet ikke helt, men her er det jeg fant», enn en AI som leverer selvsikre løgner.

Mennesket først, teknologien etterpå

Jeg har alltid trodd på at teknologi skal tjene mennesket, ikke omvendt. Design av etisk AI handler i bunn og grunn om empati. Det handler om å forstå brukerfrykt og møte den med klarhet, kontroll og respekt.

Når vi designer med tillit som grunnmur, skaper vi ikke bare smarte produkter – vi skaper ansvarlige produkter som tåler dagens lys.

3 sjekkpunkter for din AI-løsning:

- Kan brukeren forklare hvorfor systemet ga det svaret det gjorde?

- Er det enkelt for brukeren å si «nei, dette stemmer ikke»?

- Har dere vurdert hvem som faller utenfor hvis algoritmen får styre fritt?

.png)